Expertise im Überblick

Die zentralen Themenfelder meiner Arbeit:

Denken, Entscheiden, Kommunikation, KI-Nutzung und Informationsbewertung,

jeweils mit Mechanik, Praxisbezug und wissenschaftlicher Grundlage.

Diese Seite bündelt die zentralen Themenfelder meiner Arbeit und ordnet sie nach Mechanik, Praxisbezug und wissenschaftlicher Grundlage. Vertiefungen sind in aufklappbaren Abschnitten hinterlegt, damit Sie schnell orientiert bleiben und bei Bedarf ins Detail gehen können.

Wählen Sie den passenden Einstieg, scrollen Sie zu den Themenfeldern oder springen Sie zur wissenschaftlichen Grundlage

Themenfelder

Denken

Wie Urteile entstehen, wann sie kippen und wie sich Klarheit unter Druck stabilisieren lässt.

Kommunizieren

Wie Sprache, Erwartungen und Übergaben so strukturiert werden, dass Zusammenarbeit verbindlich wird.

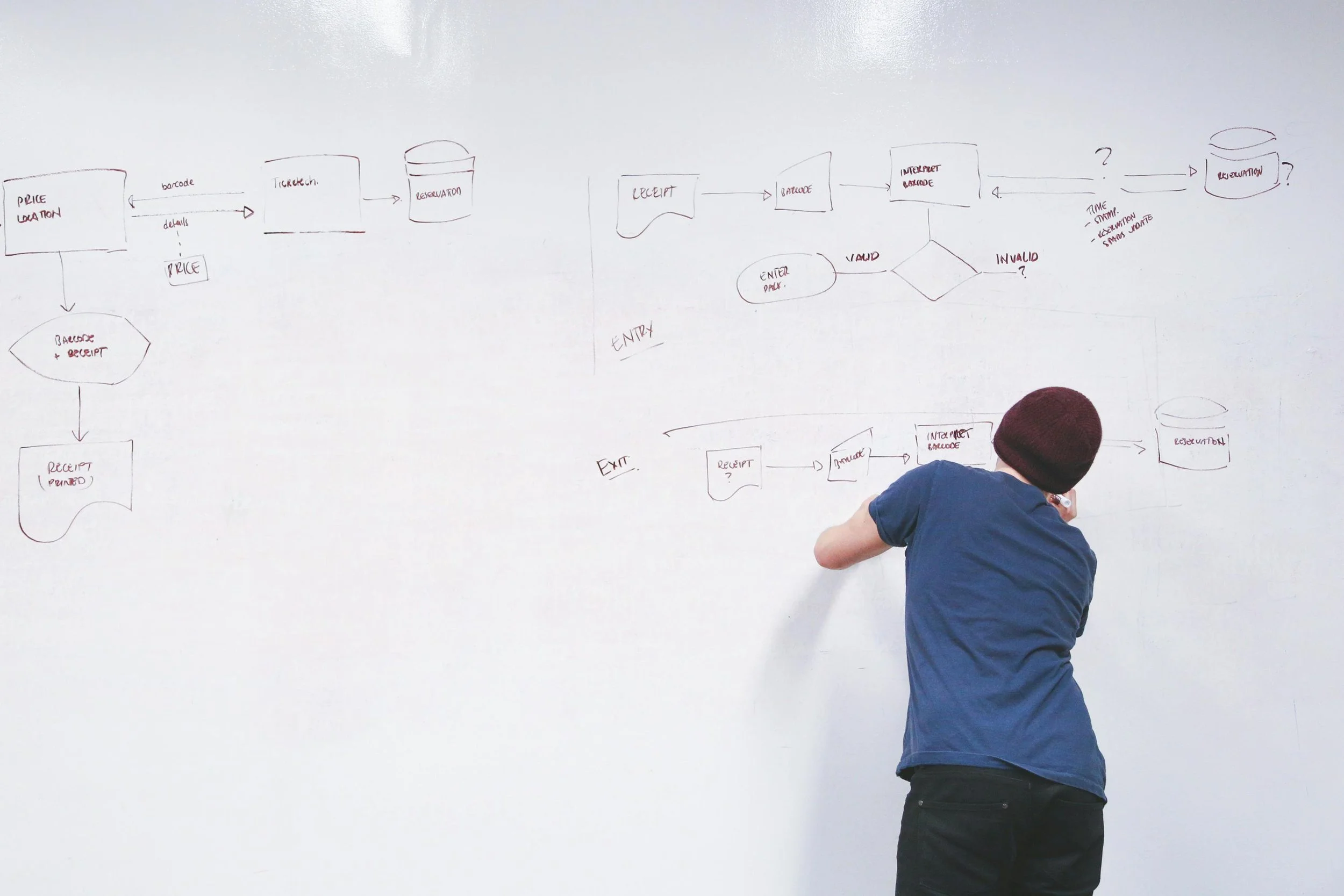

Entscheiden

Wie Kriterien, Entscheidungsrechte und Protokolle Tempo erhöhen ohne Qualität zu verlieren.

KI nutzen

Wie KI Tempo skaliert ohne Urteil abzugeben, mit klaren Checks und Grenzen.

Informationen bewerten

Wie Quellen, Evidenz und Unsicherheit geprüft werden, um Fehlschlüsse und Risiken zu reduzieren.

Denken

Unser Denken bestimmt, wie Probleme gerahmt, Informationen gewichtet und Entscheidungen getroffen werden. In komplexen Situationen kippt Qualität selten durch fehlendes Wissen, sondern durch unbemerkte Annahmen und kognitive Abkürzungen.

Typische Situationen

Argumente wirken plausibel, sind aber logisch wackelig (z. B. falsche Kausalität, Scheinsicherheit, Überverallgemeinerung).

Unsicherheit wird ignoriert oder in Scheinpräzision verwandelt, statt klar benannt und eingeordnet zu werden.

Unter Zeitdruck wird zu stark vereinfacht oder zu lange gezögert und Entscheidungen driften.

Starke Evidenz wird über- oder untergewichtet, weil Intuition, Status oder Verfügbarkeit (was gerade präsent ist) die Bewertung kippen.

Was sich verändert

Weniger kognitive Verzerrungen, weil Annahmen, Alternativen und Gegenargumente systematisch geprüft werden.

Robustere Urteile unter Druck, weil kurze Reflexions-Checks (Denkprüfungen) spontane Abkürzungen ersetzen.

Bessere Lernkurven, weil Wiederholungsfehler sichtbar werden und Entscheidungen rückblickend auswertbar sind.

Klarere Prioritäten, weil Unsicherheit explizit gemacht und Argumente nach Relevanz und Evidenz gewichtet werden statt nach Lautstärke.

Werkzeuge & Standards

Dual-Process-Checks (intuitiv vs. analytisch)

Metakognitive Fragen (Denken über das eigene Denken)

Bias- und Noise-Checks (systematische Verzerrung und zufällige Streuung)

Problem-Framing (präzises Rahmen der Frage: „Worum geht es wirklich?“)

Pre-Mortem (Vorwegnahme möglicher Fehler: „Wie könnte es scheitern?“)

Confidence Calibration (Kalibrierung von Sicherheit: „Wie sicher sind wir wirklich?“)

Passend für Sie:

-

Kritisches, analytisches und kreatives Denken zählen laut aktuellen Arbeitsmarktanalysen bis 2030 zu den wichtigsten Kernkompetenzenweltweit. In der Praxis bedeutet das: Probleme werden präziser gerahmt, Annahmen überprüft, kognitive Verzerrungen reduziert und Ambiguität in konkrete Handlungsoptionen übersetzt.

Ein zentraler Mechanismus ist das Zusammenspiel aus intuitivem Denken (System 1) und analytischem Denken (System 2). Wer beide Modi bewusst und reflektiert einsetzt, reduziert Fehlurteile, gewichtet Risiken sauberer und trifft Entscheidungen, die auch im Rückblick nachvollziehbar bleiben. Ergänzend dazu stabilisieren kognitive Kontrolle und Selbstregulation das Urteilen unter Druck: Mikro-Routinen verhindern Schnellschüsse und Entscheidungsdrift, was Rework, Konflikte und Eskalationen spürbar reduziert.

Metakognition, also das Denken über das eigene Denken, macht Urteile zusätzlich belastbarer. Wer weiß, was er weiß und wo er unsicher ist, kann Erfahrungen systematisch auswerten, Einflussfaktoren benennen und Wiederholungsfehler vermeiden. Fortschritt wird so nicht nur spürbar, sondern auch messbar.

Für Unternehmen wird Kritisches Denken damit zu einem Leistungsfaktor: Entscheidungen werden klarer, schneller und konsistenter, insbesondere in dynamischen, KI-geprägten Umgebungen. Studien belegen, dass gezieltes Training kritischer Denkstrategien systematische Denkfehler reduziert und die Qualität komplexer Entscheidungen nachweislich verbessert.

-

Albrecht, L. B. (2025). Kritisches Denken in der Chemielehrer*innenbildung: Eine konzeptionell-empirische Studie zur Integration und Operationalisierung. Logos Verlag Berlin. https://doi.org/10.30819/5970

Berthet, V. (2022). The Impact of Cognitive Biases on Professionals’ Decision-Making: A Review of Four Occupational Areas. Frontiers in Psychology, 12, 802439. https://doi.org/10.3389/fpsyg.2021.802439

Carucci, R. (2024, Februar 6). In The Age Of AI, Critical Thinking Is More Needed Than Ever. Forbes. https://www.forbes.com/sites/roncarucci/2024/02/06/in-the-age-of-ai-critical-thinking-is-more-needed-than-ever/

Larrick, R. P., & Feiler, D. C. (2015). Expertise in Decision Making. In G. Keren & G. Wu (Hrsg.), The Wiley Blackwell Handbook of Judgment and Decision Making (1. Aufl., S. 696–721). Wiley. https://doi.org/10.1002/9781118468333.ch24

Knight, A. T., Cowling, R. M., Rouget, M., Balmford, A., Lombard, A. T., & Campbell, B. M. (2008). Knowing but not doing: Selecting priority conservation areas and the research-implementation gap. Conservation biology : the journal of the Society for Conservation Biology, 22(3), 610–617. https://doi.org/10.1111/j.1523-1739.2008.00914.x

Marr, B. (2023, Februar 14). The Top 10 In-Demand Skills For 2030. Forbes. https://www.forbes.com/sites/bernardmarr/2022/08/22/the-top-10-most-in-demand-skills-for-the-next-10-years/

Midtgård, K., & Selart, M. (2025). Cognitive Biases in Strategic Decision-Making. Administrative Sciences, 15(6), 227. https://doi.org/10.3390/admsci15060227

Morewedge, C. K., Yoon, H., Scopelliti, I., Symborski, C. W., Korris, J. H., & Kassam, K. S. (2015). Debiasing Decisions: Improved Decision Making With a Single Training Intervention. Policy Insights from the Behavioral and Brain Sciences, 2(1), 129–140. https://doi.org/10.1177/2372732215600886

Theodorakopoulos, L., Theodoropoulou, A., & Halkiopoulos, C. (2025). Cognitive Bias Mitigation in Executive Decision-Making: A Data-Driven Approach Integrating Big Data Analytics, AI, and Explainable Systems. Electronics, 14(19), 3930. https://doi.org/10.3390/electronics14193930

World Economic Forum. (2025). Future of Jobs Report 2025—Insight Report. World Economic Forum. https://reports.weforum.org/docs/WEF_Future_of_Jobs_Report_2025.pdf

Young, R. (2023, August 28). The Power Of Critical Thinking: Enhancing Decision-Making And Problem-Solving. Forbes. https://www.forbes.com/councils/forbescoachescouncil/2023/07/28/enhancing-decision-making-and-problem-solving/

Wissenschaftliche Grundlage: Evidenz & Quellen ↓

Entscheiden

Entscheiden heißt nicht „sich festlegen“, sondern Optionen, Evidenz, Risiken und Prioritäten so zu strukturieren, dass ein Abschluss möglich wird und in der Umsetzung trägt. In komplexen Kontexten scheitert Qualität selten an fachlicher Kompetenz, sondern an weichen Kriterien, wechselnden Maßstäben und fehlender Anschlussfähigkeit.

Typische Situationen

Entscheidungen ziehen sich, weil Kriterien implizit bleiben oder ständig wechseln.

Risiken werden entweder wegmoderiert oder übergewichtet und blockieren den Abschluss.

Diskussionen drehen sich im Kreis, weil Optionen nicht direkt vergleichbar sind.

Nach dem Meeting ist unklar, was genau entschieden wurde und was als Nächstes gilt.

Stakeholder-Input kippt Entscheidungen nachträglich, weil der Rahmen nicht stabil ist.

Was sich verändert

Schnellere Abschlüsse, weil Kriterien, Entscheidungsrechte und „Stop-Rules“ (Abbruchregeln) klar sind.

Robustere Entscheidungen, weil Bias und Noise (systematische Verzerrung und zufällige Streuung) reduziert werden.

Weniger Schleifen, weil Optionen vergleichbar gemacht werden und Trade-offs (Zielkonflikte) explizit sind.

Höhere Umsetzungstreue, weil Entscheidungen dokumentiert, auffindbar und anschlussfähig sind.

Bessere Eskalationen, weil Konflikte und Risiken früher sichtbar werden, statt später zu explodieren.

Werkzeuge & Standards

Entscheidungs-Briefing (Entscheidungsvorlage: Problem, Optionen, Kriterien, Risiken, Empfehlung)

Kriterien-Set + Gewichtung (stabile Maßstäbe, statt Bauchgefühl)

Pre-Mortem (Vorwegnahme möglicher Fehler: „Wie könnte das scheitern?“)

Decision Log (Entscheidungsprotokoll: Entscheidung, Begründung, verantwortliche Person, nächste Schritte)

Kontrollpunkte (Entscheidungs-Meilensteine: wann Review, wann Re-Decide)

Confidence Calibration (Kalibrierung von Sicherheit: „Wie sicher sind wir wirklich?“)

Passend für Sie:

-

Gute Entscheidungen entstehen selten durch mehr Diskussion, sondern durch bessere Struktur. In komplexen Organisationen kippt Entscheidungsqualität typischerweise dort, wo Kriterien implizit bleiben, Verantwortlichkeiten verschwimmen und Entscheidungen nicht nachvollziehbar dokumentiert werden. Das Ergebnis sind Abstimmungsschleifen, Nacharbeit und Entscheidungen, die unter Druck weich werden.

Der zentrale Hebel ist Standardisierung an den richtigen Stellen: Wiederkehrende Entscheidungstypen erhalten klare Kriterien, ein kurzes Protokoll und eine saubere Logik dafür, wer entscheidet, wer Input liefert und was als ausreichend gilt. So wird Intuition nicht ersetzt, sondern kalibriert. Schnelle Einschätzungen werden durch wenige, robuste Checks abgesichert und bleiben trotz Zeitdruck nachvollziehbar.

Ein zweiter Hebel ist die Reduktion von Bias und Noise, also systematischer Verzerrung und zufälliger Streuung in Urteilen. Wenn Kriterien explizit sind und Entscheidungen konsistent dokumentiert werden, sinkt die Wahrscheinlichkeit, dass Stimmung, Stakeholder-Druck oder Tagesform das Ergebnis stärker bestimmen als Evidenz und Abwägung. Empirische Untersuchungen zeigen, dass strukturierte Entscheidungsprozesse Kohärenz, Geschwindigkeit und Erfolgswahrscheinlichkeit strategischer Entscheidungen nachweislich erhöhen.

Weil sich laut WEF bis 2030 rund 39 % aller Kernkompetenzen verändern werden, wird ein stabiler Entscheidungsrahmen zur Infrastruktur für Qualität in Unsicherheit: Teams können schneller priorisieren, Risiken sauberer abwägen und Entscheidungen wiederholbar treffen, statt jedes Mal neu zu verhandeln.

-

Berthet, V. (2022). The Impact of Cognitive Biases on Professionals’ Decision-Making: A Review of Four Occupational Areas. Frontiers in Psychology, 12, 802439. https://doi.org/10.3389/fpsyg.2021.802439

Dean, J. W., & Scharfman, M. P. (1996). Does Decision Process Matter? A Study of Strategic Decision-Making Effectiveness. Academy of Management Journal, 39(2), 368–396.

Knight, A. T., Cowling, R. M., Rouget, M., Balmford, A., Lombard, A. T., & Campbell, B. M. (2008). Knowing but not doing: Selecting priority conservation areas and the research-implementation gap. Conservation biology : the journal of the Society for Conservation Biology, 22(3), 610–617. https://doi.org/10.1111/j.1523-1739.2008.00914.x

Midtgård, K., & Selart, M. (2025). Cognitive Biases in Strategic Decision-Making. Administrative Sciences, 15(6), 227. https://doi.org/10.3390/admsci15060227

Milkman, K. L., Chugh, D., & Bazerman, M. H. (2009). How Can Decision Making Be Improved? Perspectives on Psychological Science, 4(4), 379–383. https://doi.org/10.1111/j.1745-6924.2009.01142.x

Morewedge, C. K., Yoon, H., Scopelliti, I., Symborski, C. W., Korris, J. H., & Kassam, K. S. (2015). Debiasing Decisions: Improved Decision Making With a Single Training Intervention. Policy Insights from the Behavioral and Brain Sciences, 2(1), 129–140. https://doi.org/10.1177/2372732215600886

Theodorakopoulos, L., Theodoropoulou, A., & Halkiopoulos, C. (2025). Cognitive Bias Mitigation in Executive Decision-Making: A Data-Driven Approach Integrating Big Data Analytics, AI, and Explainable Systems. Electronics, 14(19), 3930. https://doi.org/10.3390/electronics14193930

World Economic Forum. (2025). Future of Jobs Report 2025—Insight Report. World Economic Forum. https://reports.weforum.org/docs/WEF_Future_of_Jobs_Report_2025.pdf

Young, R. (2023, August 28). The Power Of Critical Thinking: Enhancing Decision-Making And Problem-Solving. Forbes. https://www.forbes.com/councils/forbescoachescouncil/2023/07/28/enhancing-decision-making-and-problem-solving/

Wissenschaftliche Grundlage: Evidenz & Quellen ↓

Kommunizieren

Kommunikation ist die Infrastruktur von Zusammenarbeit: Sie bestimmt, ob Informationen verstanden werden, ob Erwartungen eindeutig sind und ob Entscheidungen in der Umsetzung halten.

In komplexen Arbeitsumgebungen kippt Qualität selten an fehlender Gesprächsbereitschaft, sondern an unklaren Zuständigkeiten, impliziten Annahmen und fehlenden Standards für Abstimmung und Übergaben.

Typische Situationen

Inhalte werden besprochen, aber unterschiedlich verstanden, weil Begriffe, Ziele oder Prioritäten nicht operationalisiert sind.

Aufgaben und Übergaben bleiben vage, wodurch Nachfragen, Parallel-Arbeit und Rework entstehen.

Konflikte werden spät sichtbar, weil Probleme in Nebenkanälen landen oder zu lange sozial entschärft werden.

Meetings erzeugen Aktivität, aber keine klaren Entscheidungen, weil Erwartung, Input und Abschlusskriterien fehlen.

Führungskommunikation wirkt inkonsistent, weil Botschaften je nach Situation variieren und dadurch Vertrauen sinkt.

Was sich verändert

Weniger Missverständnisse, weil Ziele, Begriffe, Zuständigkeiten und Abschlusskriterien explizit gemacht werden.

Höhere Verbindlichkeit, weil Zusagen, nächste Schritte und Übergaben dokumentiert und überprüfbar sind.

Weniger Eskalationen, weil Spannungen früher sichtbar werden und Klärung strukturiert stattfinden kann.

Schnellere Koordination, weil Abstimmung über Standards läuft statt über wiederholte Rückfragen.

Mehr psychologische Sicherheit, weil Beiträge, Einwände und Fehler früher geäußert werden, ohne dass Statusspiele dominieren.

Werkzeuge & Standards

Expectation Setting (Erwartungsklärung: Ziel, Kontext, Entscheidung vs. Update, gewünschter Output)

“Definition of Done” (Abschlusskriterium: wann etwas als fertig gilt) + Next Step (nächster Schritt) + Termin/Deadline

Übergabe-Standard (Owner: verantwortliche Person, Kontext, nächste Schritte, Abhängigkeiten, Checkpoint)

Meeting-Standards (Zweck, Rollen, Input vorab, Entscheidungslogik, Abschluss und Protokoll)

Konflikt-Klärungsformat (Rolle, Anliegen, Entscheidungspunkt, Grenzen, konkrete Vereinbarung)

Kommunikations-Templates (kurze Memos/Briefings: Problem, Ziel, Optionen, Empfehlung, Risiken)

Passend für Sie:

-

Wirksame Kommunikation ist weniger Rhetorik als Standardisierung an den richtigen Stellen. Sobald Ziele, Rollen und Erwartungen nicht explizit sind, füllt das System die Lücken automatisch: mit Annahmen, Interpretationen, Statussignalen und Nebenabsprachen. Genau dort entstehen die typischen Kosten. Aufgaben werden doppelt bearbeitet, Entscheidungen verzögern sich, Konflikte werden zu spät adressiert und Verantwortung bleibt diffus.

Ein robuster Kommunikationsrahmen reduziert diese Varianz, indem er drei Dinge stabilisiert: gemeinsame Begriffe und Prioritäten, klare Zuständigkeiten und Übergaben sowie verlässliche Abschlusskriterien. Forschung zeigt, dass diese Art von Strukturierung die Qualität der Zusammenarbeit messbar verbessert und Reibungsverluste direkt reduziert, weil weniger Energie in Klärungsschleifen fließt und mehr in Umsetzung.

In Teams zeigt sich das oft unmittelbar: weniger Nachfragen, weniger Rework, weniger Eskalationen und eine deutlich höhere Verbindlichkeit. Gleichzeitig steigt die psychologische Sicherheit, weil Einwände und Unsicherheiten früher geäußert werden können, ohne dass Gesichtsverlust droht. Wer Ideen teilt, Fehler früh adressiert und Verantwortung übernimmt, braucht einen Rahmen, in dem das sicher möglich ist.

Kommunikation ist damit kein Soft Skill, sondern Infrastruktur, und damit ein zentraler Produktivitäts-, Qualitäts- und Kulturfaktor, der sich direkt in Entscheidungsgeschwindigkeit, Koordinationsaufwand und Vertrauen niederschlägt.

-

Costa, A. C., Roe, R. A., & Taillieu, T. (2001). Trust within teams: The relation with performance effectiveness. European Journal of Work and Organizational Psychology, 10(3), 225–244. https://doi.org/10.1080/13594320143000654

Detert, J. R., & Burris, E. R. (2007). Leadership Behavior and Employee Voice: Is the Door Really Open? Academy of Management Journal, 50(4), 869–884. https://doi.org/10.5465/amj.2007.26279183

Edmondson, A. (1999). Psychological Safety and Learning Behavior in Work Teams. Administrative Science Quarterly, 44(2), 350–383. https://doi.org/10.2307/2666999

Grossman, D. (2011, Juli 17). The Cost Of Poor Communications. Holmes Report. https://www.provokemedia.com/latest/article/the-cost-of-poor-communications

Katebi, A., Saheli, A. M., Aghaei, H., & Ahmadi, Q. (2024). Meta-Analysis of Communication and Organizational Performance: Moderating Effects of Research Subject, Country and Year of Publication. Journal of System Management (JSM), 10(1), 33–48. https://doi.org/10.30495/JSM.2023.1981650.1789

Lepine, J. A., & Piccolo, R. F. (2008). A Meta-Analysis of Teamwork Processes: Tests of a Multidimensional Model and Relationships with Team Effectiveness Criteria. Personnel Psychology, 61, 273–307.

Lilienfeld, S. O., Ammirati, R., & Landfield, K. (2009). Giving Debiasing Away: Can Psychological Research on Correcting Cognitive Errors Promote Human Welfare? Perspectives on Psychological Science, 4(4), 390–398. https://doi.org/10.1111/j.1745-6924.2009.01144.x

Mesmer-Magnus, J. R., & DeChurch, L. A. (2009). Information sharing and team performance: A meta-analysis. Journal of Applied Psychology, 94(2), 535–546. https://doi.org/10.1037/a0013773

Tourish, D., & Robson, P. (2006). Sensemaking and the Distortion of Critical Upward Communication in Organizations. Journal of Management Studies, 43(4), 711–730. https://doi.org/10.1111/j.1467-6486.2006.00608.x

Wiese, C. W., Burke, C. S., Tang, Y., Hernandez, C., & Howell, R. (2022). Team Learning Behaviors and Performance: A Meta-Analysis of Direct Effects and Moderators. Group & Organization Management, 47(3), 571–611. https://doi.org/10.1177/10596011211016928

Wissenschaftliche Grundlage: Evidenz & Quellen ↓

Künstliche Intelligenz (KI) nutzen

KI beschleunigt Arbeit, aber sie ersetzt kein Urteilsvermögen. In der Praxis kippt Qualität dort, wo Modelle plausibel klingen, aber falsche Sicherheit erzeugen und wo Menschen Verantwortung unbemerkt an Tools delegieren. Der Hebel ist nicht „mehr KI“, sondern Human-in-the-Loop-Standards: klare Einsatzgrenzen, Qualitätschecks und Entscheidungslogik, die Tempo skaliert, ohne Risiko zu erhöhen.

Typische Situationen

KI liefert überzeugende Antworten, aber Halluzinationen (erfundene Inhalte) oder falsche Quellen bleiben unbemerkt.

Teams übernehmen Vorschläge zu schnell, weil Output nach „Lösung“ aussieht und kritische Prüfung ausfällt.

Entscheidungen werden inkonsistent, weil Prompts, Datenbasis oder Bewertungsmaßstäbe von Person zu Person variieren.

Vertrauliche Informationen landen in Tools, weil Governance (Regeln, Freigaben, Grenzen) fehlt.

KI erzeugt Geschwindigkeit, aber mehr Rework, weil Erwartungen, Definition of Done (Definition: wann etwas wirklich fertig ist) und Verantwortlichkeiten nicht klar sind.

Was sich verändert

Höhere Verlässlichkeit, weil KI-Outputs systematisch verifiziert (Quellencheck, Gegenprobe, Plausibilität) werden.

Robusteres Entscheiden, weil Bias-Transfer (Übernahme von Verzerrungen) und Automation Bias (Übervertrauen in Systeme) abgefedert werden.

Weniger Rework, weil Qualitätsschwellen, Zuständigkeiten und Übergaben explizit sind.

Schnellere Umsetzung, weil KI dort eingesetzt wird, wo sie wirklich Hebel hat und der Rest klar manuell bleibt.

Bessere Nachvollziehbarkeit, weil Entscheidungen und Annahmen dokumentiert sind statt in Chatverläufen zu verschwinden.

Werkzeuge & Standards

Human-in-the-Loop-Regeln (wann KI, wann Mensch, wer trägt Verantwortung)

Prompt-Standards (Ziel, Kontext, Constraints, Output-Format, Prüfkriterien)

Qualitätschecks (Quellencheck, Gegenargumente, Vergleich mehrerer Ansätze)

Risiko- & Datenschutzregeln (welche Daten dürfen rein, welche nie)

Governance-Light (Freigaben, Tool-Liste, Rollen, Update- und Review-Routinen)

Entscheidungs-Briefing + KI-Anteil (welche Teile liefert KI, welche müssen geprüft werden)

Passend für Sie:

-

Künstliche Intelligenz kann Tempo skalieren, aber sie erhöht auch das Risiko für Scheinpräzision. Antworten wirken vollständig, obwohl zentrale Annahmen fehlen, Quellen unklar sind oder Unsicherheit nicht sichtbar gemacht wird. Forschung zu Reasoning-Modellen zeigt, dass ihre Genauigkeit mit steigender Problemkomplexität deutlich abnimmt, also genau dort, wo Entscheidungen besonders teuer werden, nämlich bei Priorisierung, Strategie, Risikoabwägung oder Stakeholder-Kommunikation.

Der entscheidende Unterschied entsteht durch Standards. Wenn klar ist, wofür KI genutzt wird, welche Qualität als ausreichend gilt und welche Prüfschritte obligatorisch sind, wird KI vom Spielzeug zur Infrastruktur. Human-in-the-Loop bedeutet dabei nicht langsamer, sondern kontrolliert schneller. KI übernimmt Entwurf, Struktur, Varianten und Voranalysen, während der Mensch Bewertung, Risiko, Verantwortung und finale Entscheidung absichert. Teams, die menschliches Denken bewusst in KI-gestützte Prozesse einbetten, treffen nachweislich robustere und konsistentere Entscheidungen.

Ein häufig unterschätzter Effekt ist kognitive Verschuldung. Wenn Teams Prüfkompetenz und Urteilspraxis zu stark auslagern, steigt kurzfristig die Geschwindigkeit, aber langfristig nehmen Fehler, Abhängigkeit und Rework zu. Studien weisen darauf hin, dass dieser Effekt schleichend einsetzt, weil der Kompetenzverlust erst sichtbar wird, wenn er bereits eingetreten ist.

Genau deshalb sind klare Qualitätsroutinen und Governance sinnvoll, auch in kleinen Setups. Wenige Regeln, die konsequent eingehalten werden, reichen oft aus, um Nutzen und Sicherheit gleichzeitig zu erhöhen. Da Arbeitgebende weltweit starkes Wachstum bei KI- und Big-Data-Skills erwarten, wird reflektierte Entscheidungsfähigkeit zur zentralen Voraussetzung für verantwortungsvollen und effektiven KI-Einsatz.

-

Bucher, U., Holzweißig, K., & Schwarzer, M. (2024). Künstliche Intelligenz und wissenschaftliches Arbeiten: ChatGPT & Co.: der Turbo für ein erfolgreiches Studium. Verlag Franz Vahlen.

Carucci, R. (2024, Februar 6). In The Age Of AI, Critical Thinking Is More Needed Than Ever. Forbes. https://www.forbes.com/sites/roncarucci/2024/02/06/in-the-age-of-ai-critical-thinking-is-more-needed-than-ever/

Chen, Y., Kirshner, S. N., Ovchinnikov, A., Andiappan, M., & Jenkin, T. (2025). A Manager and an AI Walk into a Bar: Does ChatGPT Make Biased Decisions Like We Do? Manufacturing & Service Operations Management, 27(2), 354–368. https://doi.org/10.1287/msom.2023.0279

Cheung, V., Maier, M., & Lieder, F. (2025). Large language models show amplified cognitive biases in moral decision-making. Proceedings of the National Academy of Sciences, 122(25), e2412015122. https://doi.org/10.1073/pnas.2412015122

Goddard, K., Roudsari, A., & Wyatt, J. C. (2012). Automation bias: A systematic review of frequency, effect mediators, and mitigators. Journal of the American Medical Informatics Association, 19(1), 121–127. https://doi.org/10.1136/amiajnl-2011-000089

Kosmyna, N., Hauptmann, E., Yuan, Y. T., Situ, J., Liao, X.-H., Beresnitzky, A. V., Braunstein, I., & Maes, P. (2025). Your Brain on ChatGPT: Accumulation of Cognitive Debt when Using an AI Assistant for Essay Writing Task (No. arXiv:2506.08872). arXiv. https://doi.org/10.48550/arXiv.2506.08872

Lee, H.-P. (Hank), Sarkar, A., Tankelevitch, L., Drosos, I., Rintel, S., Banks, R., & Wilson, N. (2025). The Impact of Generative AI on Critical Thinking: Self-Reported Reductions in Cognitive Effort and Confidence Effects From a Survey of Knowledge Workers. Proceedings of the 2025 CHI Conference on Human Factors in Computing Systems, 1–22. https://doi.org/10.1145/3706598.3713778

Milkman, K. L., Chugh, D., & Bazerman, M. H. (2009). How Can Decision Making Be Improved? Perspectives on Psychological Science, 4(4), 379–383. https://doi.org/10.1111/j.1745-6924.2009.01142.x

Mosier, K. L., Skitka, L. J., Heers, S., & Burdick, M. (1998). Automation Bias: Decision Making and Performance in High-Tech Cockpits. The International Journal of Aviation Psychology, 8(1), 47–63. https://doi.org/10.1207/s15327108ijap0801_3

Risko, E. F., & Gilbert, S. J. (2016). Cognitive Offloading. Trends in Cognitive Sciences, 20(9), 676–688. https://doi.org/10.1016/j.tics.2016.07.002

Shojaee, P., Mirzadeh, I., Alizadeh, K., Horton, M., Bengio, S., & Farajtabar, M. (2025). The Illusion of Thinking: Understanding the Strengths and Limitations of Reasoning Models via the Lens of Problem Complexity (No. arXiv:2506.06941). arXiv. https://doi.org/10.48550/arXiv.2506.06941

Theodorakopoulos, L., Theodoropoulou, A., & Halkiopoulos, C. (2025). Cognitive Bias Mitigation in Executive Decision-Making: A Data-Driven Approach Integrating Big Data Analytics, AI, and Explainable Systems. Electronics, 14(19), 3930. https://doi.org/10.3390/electronics14193930

Wissenschaftliche Grundlage: Evidenz & Quellen ↓

In einer Welt mit dauerhafter Informationsverfügbarkeit entscheidet nicht die Menge, sondern Urteilsqualität: Was ist belastbar, was ist plausibel aber falsch und was ist schlicht unklar? In Organisationen entstehen Fehlentscheidungen selten durch „zu wenig Recherche“, sondern durch schwache oder ungeprüfte Quellen, fehlende Evidenzstandards und Scheinpräzision. Der Hebel ist eine verlässliche Evidenzbasis plus klare Regeln für Unsicherheit und Kommunikation.

Informationen bewerten

Typische Situationen

Behauptungen wirken überzeugend, aber Quellen sind schwach, selektiv oder nicht nachvollziehbar.

Zahlen werden präsentiert, ohne Kontext (Basisrate, Vergleichsgruppe, Effektgrösse, Unsicherheit).

Studien, Reports oder Expertenmeinungen werden vermischt, ohne Qualität zu unterscheiden (Peer Review, Methodik, Interessenkonflikte).

Teams diskutieren Meinungen, weil Kriterien fehlen, was als ausreichende Evidenz gilt.

Kommunikation erzeugt Scheinsicherheit, weil Unsicherheit nicht klar benannt wird und später Rework oder Vertrauensverlust entsteht.

Was sich verändert

Höhere Entscheidungssicherheit, weil Evidenz nach festen Kriterien geprüft und gewichtet wird.

Weniger Desinformationseinfluss, weil typische Manipulationsmuster und Fehlschlüsse früh erkannt werden.

Bessere Priorisierung, weil Unsicherheit explizit ist und Risiken realistischer bewertet werden.

Schnellere Abstimmung, weil Teams eine gemeinsame Sprache für Evidenz, Qualität und Unklarheit nutzen.

Stärkere Außenwirkung, weil Aussagen präziser, belastbarer und konsistent kommuniziert werden.

Werkzeuge & Standards

Quellen-Check (Autorität, Datenbasis, Methodik, Interessenkonflikte, Aktualität)

Evidenz-Rubrik (was gilt als stark, mittel, schwach und warum)

Unsicherheits-Standard (was sicher ist, was unklar ist, was als nächstes geprüft wird)

Argument-Check (Fehlschlüsse, Kausalität vs. Korrelation, Basisraten, Cherry Picking)

„Claim–Evidence–Confidence“-Standard (Behauptung, Beleg, Sicherheitsskala)

Kommunikations-Template für Stakeholder (Kernaussage, Begründung, Grenzen, nächste Schritte)

Passend für Sie:

-

In einer Welt mit dauerhafter Informationsverfügbarkeit entscheidet nicht die Menge, sondern die Fähigkeit, Qualität zu beurteilen. Informationskompetenz ist keine Recherchetechnik, sondern eine Entscheidungsinfrastruktur. Sie trennt robuste Evidenz von plausibler Rhetorik und macht Unsicherheit handhabbar. Besonders in datenreichen Umgebungen entstehen Fehler, weil Aussagen zu glatt wirken: Zahlen ohne Baseline, Studien ohne Methodenkontext, Expertenzitate ohne Interessenkonflikte. Das führt zu Fehlpriorisierung, unnötigen Schleifen und Reputationsrisiken.

Ein zentraler Mechanismus ist epistemisches Wissen, also das Verständnis darüber, wie Wissen entsteht. Forschung zeigt, dass wer Kriterien für Evidenz und Unsicherheit beherrscht, irreführende Behauptungen zuverlässiger erkennt und präziser kommuniziert. In Teams wirkt das doppelt: Es verbessert die Qualität von Entscheidungen und reduziert Konflikte, weil nicht Meinung gegen Meinung steht, sondern Kriterien gegen Kriterien.

Der praktische Hebel sind wenige, konsequent genutzte Standards, wie ein kurzer Quellen- und Argumentcheck, ein gemeinsames Format für Unsicherheit und eine klare Übersetzung in Stakeholder-Kommunikation. Wer Unsicherheiten transparent benennt, statt zu glätten, stärkt Vertrauen und schützt Reputation, auch wenn nicht alles sicher ist. Damit sinkt der Rechercheaufwand, während die Robustheit steigt. Daraus resultiert, dass Entscheidungen nachvollziehbarer werden, Fehler früher erkannt werden und die Kommunikation belastbarer wird.

Für Unternehmen bedeutet das, dass trainierte Informationskompetenz die Präzision beruflicher Entscheidungen verbessert und die kognitive Resilienz von Teams in einer Arbeitswelt, in der Scheinpräzision und Fehlinformation direkte betriebswirtschaftliche Kosten verursachen, stärkt.

-

Brainard, J., Hunter, P. R., & Hall, I. R. (2020). An agent-based model about the effects of fake news on a norovirus outbreak. Revue d’Épidémiologie et de Santé Publique, 68(2), 99–107. https://doi.org/10.1016/j.respe.2019.12.001

Carucci, R. (2024, Februar 6). In The Age Of AI, Critical Thinking Is More Needed Than Ever. Forbes. https://www.forbes.com/sites/roncarucci/2024/02/06/in-the-age-of-ai-critical-thinking-is-more-needed-than-ever/

Cook, J., Ellerton, P., & Kinkead, D. (2018). Deconstructing climate misinformation to identify reasoning errors. Environmental Research Letters, 13(2), 024018. https://doi.org/10.1088/1748-9326/aaa49f

Eisenberg, M. B. (2008). Information Literacy: Essential Skills for the Information Age. DESIDOC Journal of Library & Information Technology, 28(2), 39–47. https://doi.org/10.14429/djlit.28.2.166

Feierabend, S., Rathgeb, T., Kheredmand, H., & Glöckler, S. (2022). JIM-Studie 2022: Jugend, Information, Medien. Basisuntersuchungen zum Medienumgang 12- bis 19-Jähriger. Medienpädagogischer Forschungsverbund Südwest (MPFS). https://www.mpfs.de/fileadmin/files/Studien/JIM/2022/JIM_2022_Web_final.pdf;

Fuchs, C. (2022). Verschwörungstheorien in der Pandemie: Wie über COVID-19 im Internet kommuniziert wird (1. Aufl.). utb GmbH. https://doi.org/10.36198/9783838557960

Hasebrink, U., Hölig, S., & Wunderlich, L. (2021). #UseTheNews: Studie zur Nachrichtenkompetenz Jugendlicher und junger Erwachsener in der digitalen Medienwelt. Arbeitspapiere des Hans-Bredow-Instituts. https://doi.org/10.21241/SSOAR.72822

Lewandowsky, S., Ecker, U. K. H., Seifert, C. M., Schwarz, N., & Cook, J. (2012). Misinformation and Its Correction: Continued Influence and Successful Debiasing. Psychological science in the public interest : a journal of the American Psychological Society, 13(3), 106–131. https://doi.org/10.1177/1529100612451018

Meßmer, A.-K., Sängerlaub, A., & Schulz, L. (2021). „Quelle: Internet“? Digitale Nachrichten- und Informationskompetenzen der deutschen Bevölkerung im Test (Stiftung Neue Verantwortung e. V, Hrsg.). Hochschule der Medien. https://doi.org/66090

Organisation for Economic Co-operation and Development. (2019). OECD Future of Education and Skills 2030—Conceptual learning framework—TRANSFORMATIVE COMPETENCIES FOR 2030. OECD. https://www.oecd.org/content/dam/oecd/en/about/projects/edu/education-2040/concept-notes/Transformative_Competencies_for_2030_concept_note.pdf

Sharon, A. J., & Baram‐Tsabari, A. (2020). Can science literacy help individuals identify misinformation in everyday life? Science Education, 104(5), 873–894. https://doi.org/10.1002/sce.21581

Sinatra, G. M., Kienhues, D., & Hofer, B. K. (2014). Addressing Challenges to Public Understanding of Science: Epistemic Cognition, Motivated Reasoning, and Conceptual Change. Educational Psychologist, 49(2), 123–138. https://doi.org/10.1080/00461520.2014.916216

Wissenschaftliche Grundlage: Evidenz & Quellen ↓

Wissenschaftliche Grundlage

Die folgenden Studien belegen nicht nur die Relevanz der Themenfelder, sondern die Wirksamkeit des Ansatzes selbst: Strukturierte Entscheidungsrahmen, Debiasing-Interventionen und klare Standards funktionieren nachweislich, und das auch im professionellen Kontext.

Denken & Urteilen

Studien zeigen, dass gezielte Reflexion und die Schulung metakognitiver Strategien die Entscheidungsqualität signifikant erhöhen, Grübelschleifen reduzieren und das Vertrauen in eigene Urteile stärken. Bereits kurze Interventionen zur Bias-Erkennung führen zu messbaren Verbesserungen im Entscheidungsverhalten. (Kakinohana & Pilati, 2023; Larrick & Feiler, 2015; Morewedge et al., 2015)

Entscheiden in Organisationen

Organisationen mit klar definierten Entscheidungsrahmen und strukturierten Bewertungsprozessen entscheiden schneller, konsistenter und mit höherer Qualität. Bias-sensible Entscheidungsarchitekturen reduzieren nachweislich Rework, erhöhen strategische Kohärenz und stärken das Vertrauen in Führung und Entscheidungsprozesse. (Dean & Sharfman, 1996; Harvard Business Review, 2016, 2020a, 2020b; Larrick & Feiler, 2015; Milkman et al., 2009; ; Theodorakopoulos et al., 2025)

Teamkommunikation & Zusammenarbeit

Strukturierte Reflexionsroutinen, klare Entscheidungsrahmen und präzise Kommunikation verbessern die Koordination, reduzieren Rework und führen zu qualitativ besseren Ergebnissen. Psychologische Sicherheit und gemeinsame Bias-Erkennung steigern Kommunikationsqualität und Entscheidungsgeschwindigkeit nachweislich. (Curşeu & Schruijer, 2012; Jones & Roelofsma, 2000; Midtgård & Selart, 2025; Rutka et al., 2023)

Trainings & Interventionen

Bereits kurze, evidenzbasierte Trainings bewirken deutliche Verbesserungen in Urteils- und Entscheidungsprozessen. Formate die auf Bias-Erkennung und metakognitive Einsicht abzielen, fördern nachhaltige Veränderungen im Denken und Handeln, insbesondere bei Fach- und Führungskräften. (Berthet, 2022; Lilienfeld et al., 2009; Midtgård & Selart, 2025; Morewedge et al., 2015; Siebert et al., 2021)

KI & Informationsbewertung

Mit steigender KI-Nutzung wächst das Risiko von Bias-Transfer und unkritischem Vertrauen in Modellergebnisse. Studien zeigen, dass KI-Modelle kognitive Verzerrungen nicht nur reproduzieren, sondern verstärken können. Strukturierte Human-in-the-Loop-Checks und klare Qualitätsstandards reduzieren diese Risiken nachweislich. (Cheung et al., 2025; Goddard et al., 2012; Lee et al., 2025)

-

Berthet, V. (2022). The Impact of Cognitive Biases on Professionals’ Decision-Making: A Review of Four Occupational Areas. Frontiers in Psychology, 12, 802439. https://doi.org/10.3389/fpsyg.2021.802439

Cheung, V., Maier, M., & Lieder, F. (2025). Large language models show amplified cognitive biases in moral decision-making. Proceedings of the National Academy of Sciences, 122(25), e2412015122. https://doi.org/10.1073/pnas.2412015122

Curşeu, P. L., & Schruijer, S. G. L. (2012). Decision Styles and Rationality: An Analysis of the Predictive Validity of the General Decision-Making Style Inventory. Educational and Psychological Measurement, 72(6), 1053–1062. https://doi.org/10.1177/0013164412448066

Dean, J. W., & Scharfman, M. P. (1996). Does Decision Process Matter? A Study of Strategic Decision-Making Effectiveness. Academy of Management Journal, 39(2), 368–396.

Goddard, K., Roudsari, A., & Wyatt, J. C. (2012). Automation bias: A systematic review of frequency, effect mediators, and mitigators. Journal of the American Medical Informatics Association, 19(1), 121–127. https://doi.org/10.1136/amiajnl-2011-000089

Jones, P. E., & Roelofsma, P. H. M. P. (2000). The potential for social contextual and group biases in team decision-making: Biases, conditions and psychological mechanisms. Ergonomics, 43(8), 1129–1152. https://doi.org/10.1080/00140130050084914

Kakinohana, R. K., & Pilati, R. (2023). Differences in decisions affected by cognitive biases: Examining human values, need for cognition, and numeracy. Psicologia: Reflexão e Crítica, 36(1), 26. https://doi.org/10.1186/s41155-023-00265-z

Larrick, R. P., & Feiler, D. C. (2015). Expertise in Decision Making. In G. Keren & G. Wu (Hrsg.), The Wiley Blackwell Handbook of Judgment and Decision Making (1. Aufl., S. 696–721). Wiley. https://doi.org/10.1002/9781118468333.ch24

Lee, H.-P. (Hank), Sarkar, A., Tankelevitch, L., Drosos, I., Rintel, S., Banks, R., & Wilson, N. (2025). The Impact of Generative AI on Critical Thinking: Self-Reported Reductions in Cognitive Effort and Confidence Effects From a Survey of Knowledge Workers. Proceedings of the 2025 CHI Conference on Human Factors in Computing Systems, 1–22. https://doi.org/10.1145/3706598.3713778

Lilienfeld, S. O., Ammirati, R., & Landfield, K. (2009). Giving Debiasing Away: Can Psychological Research on Correcting Cognitive Errors Promote Human Welfare? Perspectives on Psychological Science, 4(4), 390–398. https://doi.org/10.1111/j.1745-6924.2009.01144.x

Midtgård, K., & Selart, M. (2025). Cognitive Biases in Strategic Decision-Making. Administrative Sciences, 15(6), 227. https://doi.org/10.3390/admsci15060227

Milkman, K. L., Chugh, D., & Bazerman, M. H. (2009). How Can Decision Making Be Improved? Perspectives on Psychological Science, 4(4), 379–383. https://doi.org/10.1111/j.1745-6924.2009.01142.x

Morewedge, C. K., Yoon, H., Scopelliti, I., Symborski, C. W., Korris, J. H., & Kassam, K. S. (2015). Debiasing Decisions: Improved Decision Making With a Single Training Intervention. Policy Insights from the Behavioral and Brain Sciences, 2(1), 129–140. https://doi.org/10.1177/2372732215600886

Siebert, J. U., Kunz, R. E., & Rolf, P. (2021). Effects of decision training on individuals’ decision-making proactivity. European Journal of Operational Research, 294(1), 264–282. https://doi.org/10.1016/j.ejor.2021.01.010

Theodorakopoulos, L., Theodoropoulou, A., & Halkiopoulos, C. (2025). Cognitive Bias Mitigation in Executive Decision-Making: A Data-Driven Approach Integrating Big Data Analytics, AI, and Explainable Systems. Electronics, 14(19), 3930. https://doi.org/10.3390/electronics14193930

Passender Einstieg

Bereit anzufangen? Wählen Sie Ihren Einstieg oder schreiben Sie mir direkt.

Bereit, Klarheit in ein System zu übersetzen?